- El hardware del PC se basa en la representación binaria de la información y en la interacción coordinada de CPU, memoria, buses y almacenamiento.

- Placa base, chipset, RAM, caché y tipos de interfaces (SATA, USB, etc.) determinan la capacidad de ampliación y el rendimiento real del sistema.

- Periféricos, puertos de comunicación y monitores permiten la interacción con el usuario y condicionan la experiencia de uso del ordenador.

- Un mantenimiento periódico de limpieza y ventilación es clave para conservar el rendimiento y alargar la vida útil del hardware del PC.

Cuidar bien de tu ordenador no es solo cuestión de que arranque rápido o vaya fluido cuando abres juegos y programas. Un PC es una máquina electrónica compleja en la que intervienen decenas de componentes de hardware trabajando juntos, y si no los entiendes mínimamente es fácil tomar malas decisiones de compra, hacer ampliaciones inútiles o, directamente, acortar la vida del equipo por falta de mantenimiento.

En esta guía vamos a hacer un recorrido completo por el hardware de un PC (ver la guía completa de análisis de hardware para PC): desde cómo se representa la información en bits y bytes hasta la función de la placa base, el microprocesador, la memoria, los discos y los puertos. Además, veremos por qué es tan importante realizar un mantenimiento y limpieza periódica del ordenador para evitar pérdida de rendimiento, ruidos excesivos y averías provocadas por el calor y la suciedad.

Cómo se entiende un ordenador con nosotros: del lenguaje humano al binario

Un ordenador no “comprende” letras ni palabras tal y como las vemos en pantalla; en realidad todo se reduce a corriente eléctrica que pasa o no pasa por millones de diminutos interruptores integrados en microchips.

Estos interruptores electrónicos solo tienen dos estados posibles: activado o desactivado, lo que se corresponde con un 1 o un 0 en el sistema binario. A cada uno de estos estados se le llama bit, que es la unidad de información más pequeña que puede manejar un PC.

Como un solo bit apenas representa información, se agrupan en conjuntos de 8 bits para formar un byte, que equivale a un carácter, un número o incluso un espacio en blanco. A partir de ahí se utilizan múltiplos: kilobyte (KB), megabyte (MB), gigabyte (GB) o terabyte (TB), donde cada paso se basa en potencias de 2 (por ejemplo, 1 KB son 1024 bytes, no 1.000).

Para que las letras, símbolos y números que usamos puedan representarse en forma binaria, se emplean sistemas de codificación como el código ASCII, que asigna a cada carácter una combinación de 8 bits. Así, al pulsar la tecla A en el teclado, en realidad se envía al microprocesador la secuencia concreta de unos y ceros que representa esa letra.

La velocidad con la que se mueven estos datos también se mide usando bytes o bits por segundo: B/s, KB/s, MB/s o Gb/s y Mbps, Kbps, etc.. Hay que fijarse bien en si la unidad está en bits (b minúscula) o en bytes (B mayúscula), porque 1 MB/s no es lo mismo que 1 Mbps: en números, 1 MB/s equivale a 8 Mbps.

Unidades de almacenamiento y medidas de velocidad

En informática, cuando se habla de la “capacidad” de un dispositivo se está hablando del número total de bytes que puede guardar en su interior. Como un byte es muy pequeño, se usan sus múltiplos: KB, MB, GB o TB, que encontrarás en discos duros, SSD, memorias USB, etc.

Por ejemplo, un documento de texto muy simple que pese 1 KB está compuesto por 1024 caracteres, espacios o números. Un archivo de varios MB ya contiene miles de veces más información, y así sucesivamente. Cuantos más bytes pueda almacenar un dispositivo, mayor es su capacidad.

En cuanto a la velocidad, la cosa cambia. Para medir la rapidez con la que se transfieren datos se emplean unidades como KB/s, MB/s, GB/s o, en conexiones de red, Kbps y Mbps. Aquí es muy fácil confundirse si no se presta atención a las abreviaturas, sobre todo cuando contratamos una conexión a Internet.

Además de la velocidad de transferencia, en hardware es muy habitual hablar de frecuencia, expresada en hertzios (Hz), MHz o GHz. Esta unidad indica cuántas veces por segundo un componente repite una operación concreta, como puede ser el “tic-tac” del reloj interno de la CPU que marca el ritmo al que se ejecutan las instrucciones.

Cuando se dice que un microprocesador funciona a 3 GHz significa, literalmente, que puede realizar tres mil millones de ciclos de reloj por segundo. En cada ciclo puede hacer una cierta cantidad de trabajo según su arquitectura, su número de núcleos, el tamaño de la caché, etc.

Factores que determinan la velocidad de un ordenador

La rapidez de un PC no depende de un único componente milagroso; es el resultado de cómo interactúan varios elementos, como el microprocesador, la memoria RAM, el bus de datos y la unidad de almacenamiento.

Por un lado, cada CPU está diseñada para trabajar con un determinado ancho interno, es decir, con un número concreto de bits a la vez (16, 32 o 64 bits). Cuantos más bits pueda manejar de golpe, mayor cantidad de información procesa en cada ciclo. Hoy en día, prácticamente todos los procesadores domésticos son de 64 bits.

El reloj interno del sistema marca la frecuencia de trabajo y determina cuántos ciclos por segundo es capaz de realizar la CPU. Un procesador a 2 MHz podía ejecutar unos dos millones de instrucciones por segundo en su época; los actuales, con varios GHz y múltiples núcleos, superan esa cifra de forma abrumadora.

Además del micro, el llamado bus de datos actúa como una autopista por la que viaja la información entre los distintos componentes: memoria, disco, tarjeta gráfica, etc. El número de bits que puede transportar en paralelo (su ancho) y la frecuencia a la que opera influyen directamente en la rapidez de esos intercambios.

Por todo ello, el rendimiento global del equipo viene marcado por varios factores simultáneos: número de bits internos del micro, su frecuencia de reloj, el ancho y la velocidad del bus de datos y la cantidad de memoria RAM disponible. Una sola pieza muy potente no compensará un cuello de botella en el resto.

La caja del PC y la fuente de alimentación

Lo primero que vemos de un ordenador de sobremesa es la torre, pero lejos de ser solo estética, la elección de la caja influye mucho en la ventilación interna y en el espacio para instalar unidades y ventiladores.

Una caja pequeña tiene menos bahías para discos, menos huecos para añadir ventiladores y suele favorecer la acumulación de calor y polvo. Una torre de tamaño medio o grande facilita la circulación de aire y la organización de cables, lo que a la larga reduce la temperatura y el ruido del sistema.

Junto con la caja, la fuente de alimentación es otro componente básico y muchas veces infravalorado. Su misión es convertir la corriente alterna de la red (220V) en tensiones continuas bajas (típicamente +5V y +12V) que los componentes del PC puedan utilizar sin dañarse.

Una fuente de mala calidad o insuficiente potencia puede provocar reinicios, cuelgues, ruidos eléctricos e incluso averías en otros componentes. Por eso es recomendable elegir una fuente con certificación de eficiencia, potencia suficiente y protecciones internas frente a picos de tensión, cortocircuitos, etc.

Placa base, ranuras y chipset

La placa base (o motherboard) es el “esqueleto” sobre el que se monta todo el sistema. En ella se conectan el procesador, la memoria, los discos, la tarjeta gráfica y el resto de tarjetas de expansión, y gracias a sus pistas internas circula toda la información que se intercambian los componentes.

Cada placa está diseñada para ser compatible con una familia concreta de procesadores (tipo de socket) y un conjunto de tecnologías (memoria soportada, tipo de puertos, etc.). Por eso, al montar o actualizar un equipo es vital comprobar que placa, micro, RAM y tarjetas son compatibles entre sí.

A lo largo del tiempo han existido diversos tipos de ranuras y conectores en la placa base. Entre las más importantes destacan las ranuras PCI y PCI Express (PCIe), usadas para tarjetas de sonido, red, capturadoras o gráficas, y los zócalos específicos para módulos de memoria, como DIMM. Hoy prácticamente todas las expansiones modernas utilizan PCIe.

Para la conexión de unidades de almacenamiento se usaron durante muchos años los conectores IDE o PATA, ya obsoletos en PCs actuales. En su lugar, se generalizó el uso de puertos SATA, que permiten mayores velocidades de transferencia y cables más finos y manejables. Algunos equipos incorporan también conectores SATA externos para discos duros portátiles.

Dentro de la placa base, buena parte de la lógica de control se agrupa en el llamado chipset. Este conjunto de circuitos coordina la comunicación entre la CPU, la memoria, los buses de expansión y los distintos puertos (USB, PCIe, etc.), y en gran medida determina las prestaciones y posibilidades de ampliación del equipo.

De la calidad y características del chipset dependen aspectos como la cantidad máxima de RAM soportada, el número de líneas PCIe, la compatibilidad con determinadas tecnologías de almacenamiento y, en general, el rendimiento real que se puede exprimir del procesador instalado.

Controladoras y tipos de interfaces de almacenamiento

La enorme cantidad de datos que se mueve constantemente en un PC obliga a tener componentes especializados que gestionen el tráfico hacia y desde ciertos dispositivos. Estos elementos se conocen como controladoras o interfaces de hardware.

Una controladora se encarga de coordinar el flujo de información entre el sistema (especialmente la CPU y la memoria) y un dispositivo concreto: discos duros, unidades ópticas, tarjetas de expansión o incluso puertos externos. Pueden ir integradas en la propia placa base o formar parte del dispositivo conectado.

Entre los estándares más conocidos encontramos IDE, EIDE, ATA, Serial ATA (SATA) o UltraDMA para discos clásicos, y SCSI o FireWire para dispositivos de alto rendimiento. Cada uno usa su propia combinación de conector, cable y protocolo de comunicación, lo que obliga a utilizar la controladora adecuada en cada caso.

Hoy en día, en equipos domésticos lo habitual es que la mayoría de los discos usen conexiones SATA, mientras que SCSI y FireWire han quedado relegados a entornos más específicos o han sido reemplazados en gran medida por PCIe y USB de alta velocidad.

ROM, BIOS y pila de la placa

Para que un PC arranque correctamente al pulsar el botón de encendido, necesita disponer de unas instrucciones básicas siempre disponibles, incluso cuando el equipo está apagado. Tradicionalmente esto lo proporcionaba la memoria ROM, una memoria de solo lectura en la que el fabricante grababa de fábrica ese pequeño programa de arranque.

Con el tiempo, la ROM clásica ha sido sustituida por sistemas más flexibles como la BIOS (Basic Input/Output System) o los firmware UEFI actuales, que siguen almacenándose en chips no volátiles, pero permiten modificar ciertos parámetros de configuración del hardware.

En la BIOS se guardan datos esenciales: tipo de procesador, configuración de la memoria, características de los discos, orden de arranque, fecha y hora, etc. Para evitar que esta configuración se pierda cuando apagamos el ordenador, la placa base incorpora una pequeña pila (acumulador) que mantiene alimentada esa memoria.

Cuando la pila se agota, el síntoma típico es que el equipo olvida la hora y la fecha o vuelve continuamente a los valores de fábrica, lo que obliga a cambiarla por otra nueva. Es una avería sencilla y barata, pero sin esa pila sería necesario reconfigurar la BIOS cada vez que encendemos el PC.

Memoria RAM, caché y memoria virtual

La memoria principal o RAM (Random Access Memory) es el lugar donde el ordenador guarda los datos y programas que está utilizando en ese momento. A diferencia del disco duro, la RAM es una memoria volátil: su contenido se pierde al apagar el equipo.

Cuando abrimos un programa, el sistema operativo copia sus instrucciones y datos desde la unidad de almacenamiento a la RAM, porque es muchísimo más rápida. Desde ahí, la CPU puede leer y escribir información a gran velocidad mientras el software se está ejecutando.

A la hora de elegir módulos de memoria hay dos datos clave: la capacidad total (por ejemplo 8 GB, 16 GB, 32 GB…) y la frecuencia o velocidad de transferencia de datos medida en MHz. Cuanta más RAM tengamos, más programas podremos tener abiertos a la vez sin tirar de memoria virtual, y cuanto mayor sea su frecuencia (y menor latencia), mejor será el rendimiento.

Es posible ampliar la RAM añadiendo módulos adicionales, siempre que la placa base lo permita y sean del tipo correcto (DDR2, DDR3, DDR4, DDR5…). Si se mezclan módulos de distinta velocidad, todos funcionarán a la frecuencia del más lento, así que conviene usar memorias lo más homogéneas posible.

Además de la RAM principal, los procesadores modernos incorporan varios niveles de memoria caché (L1, L2 y L3). Se trata de una memoria muy rápida pero de poca capacidad, ubicada dentro del propio micro, donde se guardan los datos e instrucciones que la CPU necesita con más frecuencia.

La caché L1 es la más pequeña y rápida, situada justo al lado de los núcleos, con tamaños habituales de unos pocos cientos de KB por núcleo. La L2 es algo más grande y lenta, y la L3, todavía mayor, comparte información entre varios núcleos. Gracias a esta jerarquía, el procesador puede consultar primero la caché y, solo si no encuentra lo que busca, acudir a la RAM, que es más lenta.

Cuando la memoria RAM física se queda corta, el sistema operativo recurre a la llamada memoria virtual. Esta se implementa reservando una parte del espacio del disco duro o SSD para usarlo como si fuera RAM adicional. El archivo que gestiona este espacio se conoce como archivo de paginación.

La memoria virtual evita que el ordenador se quede sin espacio para abrir programas, pero tiene un coste: el disco es muy lento comparado con la RAM, por lo que el equipo se vuelve pesado y responde con retrasos cuando se abusa de ella. Si constantemente se está intercambiando información entre RAM y disco, conviene plantearse aumentar la memoria física.

El microprocesador: corazón del PC

El microprocesador o CPU (Central Processing Unit) es, en esencia, el “cerebro” del ordenador. Es el componente encargado de ejecutar todas las operaciones lógicas y aritméticas, así como de coordinar el trabajo del resto del hardware.

Internamente, una CPU se divide en varias unidades, entre las que destacan la unidad aritmético-lógica (ALU) y la unidad de control. La ALU es la responsable de realizar sumas, restas, multiplicaciones, divisiones y operaciones lógicas con los números binarios que maneja el sistema.

La unidad de control, por su parte, marca el orden en que se ejecutan las instrucciones, supervisa los saltos en el programa y coordina el movimiento de datos entre la caché, la RAM y los diferentes registros internos del procesador. Juntas permiten que la CPU procese millones o miles de millones de instrucciones por segundo, según su frecuencia de reloj.

Al elegir un procesador, hay varios aspectos a valorar: el tipo y generación concreta (familia Intel, AMD, etc.), el socket compatible con la placa base, la frecuencia base y turbo, el número de núcleos e hilos, el tamaño de la memoria caché y la arquitectura de 64 bits. Todos estos factores influyen en su rendimiento en tareas concretas. Si te interesa la arquitectura ARM, consulta nuestra guía de procesadores Snapdragon para PC.

El microprocesador genera bastante calor cuando trabaja, por lo que necesita un buen sistema de refrigeración. Lo habitual es montar un disipador de aluminio o cobre con un ventilador encima de la CPU, utilizando pasta térmica entre ambos para mejorar la transferencia del calor hacia el bloque metálico.

Si se aumenta la frecuencia de trabajo (overclock) sin mejorar la refrigeración, la temperatura del micro puede dispararse y provocar inestabilidad, cuelgues e incluso daños permanentes. Por eso es fundamental vigilar las temperaturas y mantener limpio el disipador y el ventilador de polvo.

Puertos y conectores del ordenador

Para comunicarse con el exterior, un PC dispone de múltiples puertos y conectores, cada uno pensado para un tipo de periférico o señal concreta. Todos ellos actúan como puntos de entrada y salida de información entre el ordenador y otros dispositivos.

Entre los puertos más habituales están los conectores de audio (generalmente minijack de colores) para altavoces, micrófonos y otros equipos de sonido. También existieron durante años los puertos PS/2, diseñados específicamente para conectar teclado y ratón, aunque hoy prácticamente han desaparecido en favor del USB.

El puerto USB (Universal Serial Bus) es el estándar dominante en ordenadores modernos. Permite conectar ratones, teclados, impresoras, pendrives, discos externos y un sinfín de dispositivos. Las versiones más extendidas han sido USB 2.0 (con conectores negros) y USB 3.0 (generalmente azules), cada una con velocidades de transferencia superiores a la anterior.

Para la conexión de red se usa el puerto Ethernet (RJ45), que permite enlazar el PC con routers, switches o directamente con la ONT de la operadora. Muchos equipos incorporan también puertos SATA externos para discos e interfaces de alta velocidad como FireWire, que se empleaba sobre todo en cámaras de vídeo y dispositivos profesionales.

En la parte de vídeo encontramos conectores VGA (analógicos, de color azul), DVI, HDMI o, en equipos modernos, DisplayPort. El HDMI se ha popularizado enormemente porque transporta imagen y sonido digital de alta definición por el mismo cable, lo que lo hace ideal para monitores y televisores.

Junto a los puertos físicos, muchas conexiones actuales recurren a tecnologías inalámbricas. Los ordenadores portátiles suelen incluir ya de serie módulos Wi-Fi y Bluetooth para conectarse a redes y a periféricos sin cables, y en el pasado también se utilizaron puertos de infrarrojos para transmisiones de corto alcance.

Periféricos: entrada, salida y almacenamiento

Se considera periférico a todo dispositivo externo conectado al ordenador que sirve para introducir datos, obtener resultados o ambas cosas. Ratón, teclado, impresora, monitor, escáner, auriculares o pendrives son ejemplos claros de elementos que amplían las capacidades del PC y permiten al usuario interactuar con él.

Los periféricos de entrada sirven para mandar información al ordenador (por ejemplo, teclado o ratón). Los de salida proporcionan resultados al usuario, como monitores, impresoras o altavoces. Y los de entrada/salida permiten ambas funciones, como un disco externo en el que leemos y escribimos datos.

Entre los dispositivos de almacenamiento destacados, el disco duro es la unidad principal en la mayoría de ordenadores. Internamente, los discos mecánicos están formados por varios platos metálicos recubiertos de material magnético que giran a gran velocidad alrededor de un eje central.

Un brazo con cabezales de lectura/escritura se desplaza sobre la superficie de los platos para acceder a los datos grabados en pequeñas zonas denominadas pistas y sectores. La velocidad de giro, medida en rpm (revoluciones por minuto), influye directamente en el tiempo de acceso y la rapidez con la que el disco puede entregar información al sistema.

Durante años eran frecuentes discos de 3.600 rpm; después se popularizaron los de 5.400 rpm y 7.200 rpm, y en el terreno profesional aparecieron unidades de 10.000 rpm o más. Al elegir un disco hay que fijarse en su capacidad (GB o TB) y en su velocidad, aunque hoy muchos equipos han dado el salto a unidades SSD, que no tienen partes móviles y son muchísimo más rápidas.

A nivel lógico, la superficie de un disco se organiza en pistas, sectores y clústeres. Cada sector suele almacenar 512 bytes, y varios sectores forman un clúster, que es la unidad mínima de espacio que el sistema operativo puede asignar a un archivo. Si el tamaño del clúster es grande, se desperdicia espacio cuando se guardan muchos archivos pequeños.

Durante mucho tiempo los ordenadores contaron también con unidades lectoras/grabadoras de CD-ROM y DVD. Estas unidades se diferenciaban por sus velocidades de lectura y escritura, expresadas como múltiplos (x) de una velocidad base. En las grabadoras, era frecuente ver tres valores: velocidad de lectura, de regrabación y de grabación.

En el caso de los DVD, surgieron soportes de doble capa que permiten almacenar datos en dos niveles superpuestos, duplicando aproximadamente la capacidad del disco. Para leer o grabar estos formatos es necesario disponer de un lector o grabadora compatible con doble capa. Otro parámetro relevante en las grabadoras es el tamaño del buffer interno, que sirve de colchón para no interrumpir el flujo de datos durante la grabación.

Monitores y calidad de imagen

El monitor es el principal periférico de salida de un PC y su evolución ha sido enorme en las últimas décadas. Los antiguos monitores CRT, basados en tubos de rayos catódicos, se medían sobre todo por el tamaño de la pantalla en pulgadas y por su frecuencia de refresco en Hz, que indicaba cuántas veces por segundo se redibujaba la imagen.

Una frecuencia demasiado baja provocaba parpadeos y fatiga visual, por lo que se consideraba aceptable a partir de 60 Hz y más cómodo cuanto más se acercaba a 75 Hz o 85 Hz. Además, importaba el llamado “paso de punto”, una medida relacionada con la distancia entre los puntos de fósforo que formaban la imagen, que influía en la nitidez.

Con la llegada de las pantallas planas TFT y LCD, el paradigma cambió. Estos monitores no parpadean como los CRT, pero tienen otras características a valorar: resolución nativa, tamaño, tipo de panel y, sobre todo, el tiempo de respuesta medido en milisegundos. Un tiempo de respuesta elevado puede provocar estelas o “fantasmas” detrás de objetos en movimiento rápido.

En pantallas LCD se considera razonable un tiempo de respuesta bajo (como 5 ms o menos) para evitar rastros visibles al mover el ratón o al jugar. Además, estos paneles funcionan mejor a su resolución nativa; si se fuerza otra distinta, la imagen pierde nitidez y se ve borrosa.

Hoy encontramos también monitores LED, OLED, 3D y con altas tasas de refresco (144 Hz, 240 Hz, etc.), pensados especialmente para juegos competitivos o trabajos de edición exigentes. Al elegir un monitor conviene equilibrar factores como tamaño, resolución, tasa de refresco, tipo de panel y conectividad para adaptarse al uso principal que vayamos a darle al PC.

Mantenimiento y limpieza del hardware del PC

Más allá de conocer las partes del hardware, es fundamental asumir que un ordenador necesita cuidados periódicos. Con el uso, el polvo se acumula dentro de la torre, se tapan las rejillas y aletas de los disipadores y los ventiladores se llenan de suciedad, lo que reduce drásticamente la capacidad de refrigeración del sistema; por eso, aprende a optimizar el flujo de aire de tu PC.

Cuando esto ocurre, los componentes funcionan a mayor temperatura, los ventiladores se ven obligados a girar más rápido y el equipo empieza a sonar más de lo normal. Si se mantiene esta situación durante mucho tiempo, el calor excesivo puede provocar cuelgues, apagados inesperados o incluso dañar de forma permanente la CPU, la gráfica o la fuente.

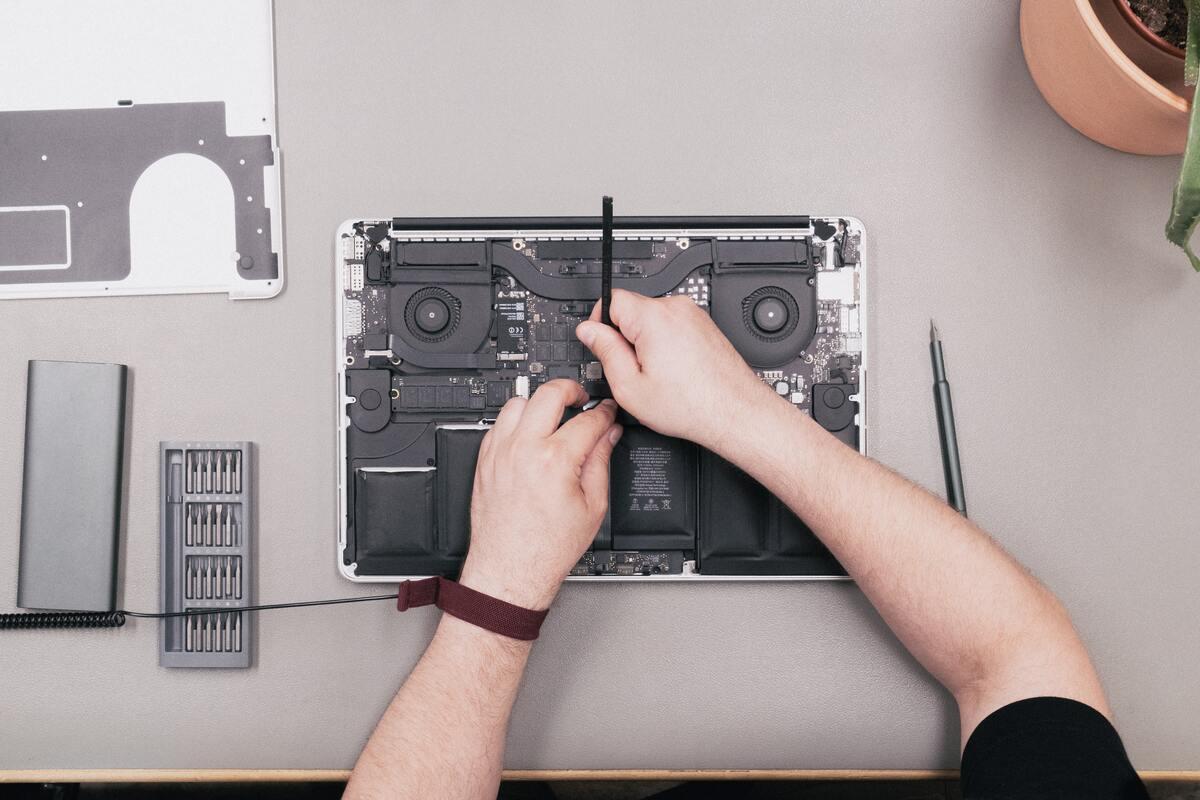

Por eso, cada cierto tiempo conviene apagar el PC, desconectarlo de la corriente y abrir la caja para hacer una limpieza a fondo. Usando aire comprimido, brochas antiestáticas y algo de paciencia, se pueden retirar las pelusas de los ventiladores, rejillas, filtros, disipadores y zonas críticas de la placa base.

También es buena idea revisar el estado de la pasta térmica entre la CPU y su disipador, comprobar que todos los ventiladores giran sin ruidos extraños y que los cables internos no entorpecen el flujo de aire desde los ventiladores frontales hacia la parte trasera y superior de la caja.

Con estos cuidados, junto con una buena elección de componentes equilibrados (micro, RAM, gráfica, disco y placa base — consulta nuestra guía de PC gaming económico), se consigue que el ordenador se mantenga silencioso, fresco y con un rendimiento estable durante muchos más años, evitando la típica situación de montar un “motor de lujo” en un chasis pobre que limita todo el conjunto.

Teniendo claro cómo se almacena y transmite la información en bits y bytes, qué papel desempeñan la CPU, la RAM, la placa, los buses, las unidades de disco y los periféricos, y asumiendo un mantenimiento periódico de limpieza y ventilación, se vuelve mucho más sencillo tomar decisiones acertadas al montar, actualizar o cuidar un PC, logrando así un equipo equilibrado, fiable y con una vida útil mucho más larga.